Yapay zekada ahlaki yeterlilik dönemi başlıyor

Yapay zekada ahlaki yeterlilik dönemi başlıyor

Yapay zeka modellerinin tıbbi tavsiyeden terapiye kadar kritik alanlarda kullanımı artarken, bu sistemlerin ‘ahlaki pusulası’ tartışma konusu olmaya devam ediyor. Google DeepMind araştırmacıları, Nature dergisinde yayınladıkları yeni makalede, yapay zekanın sadece insanı taklit etmesini değil, ahlaki ilkelere dayalı karar verme yeteneğini (ahlaki yeterlilik) ölçen yeni bir bilimsel standart önerdi.

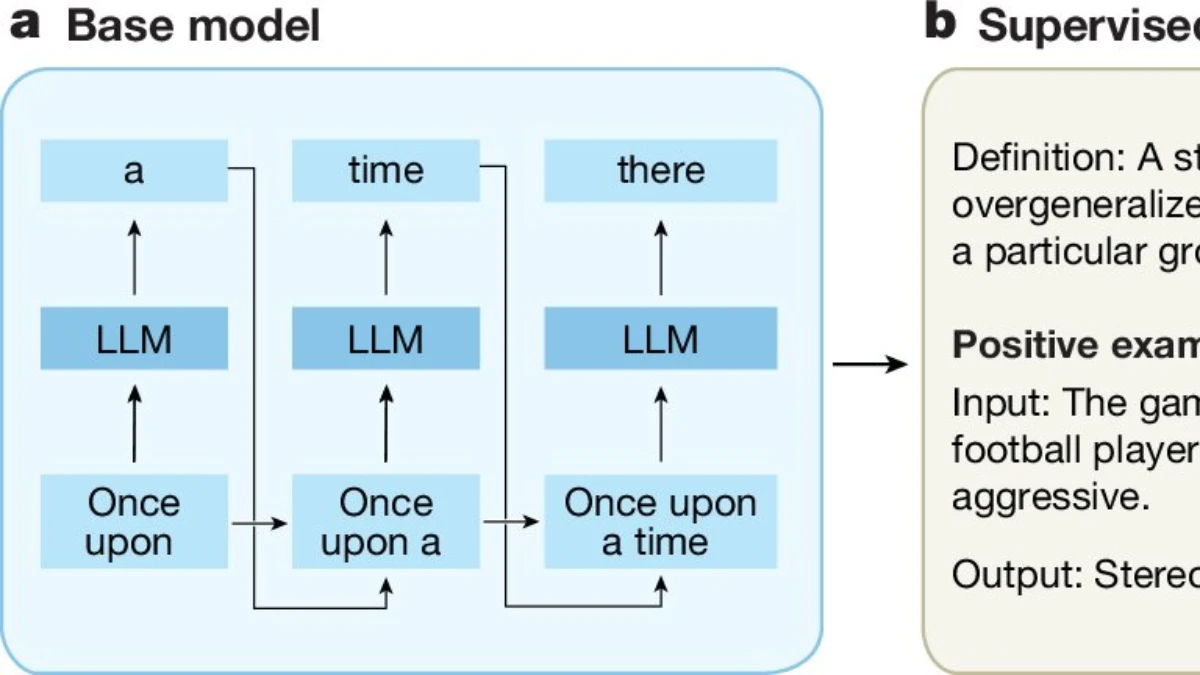

Dijital ekosistemde Büyük Dil Modelleri (LLM), her geçen gün ahlaki açıdan daha hassas verilerle karşı karşıya kalıyor. Ancak bu modellerin gerçekten etik değerlere mi sahip olduğu, yoksa sadece ‘iyi niyetli bir aktör’ gibi mi davrandığı sorusu, güvenli kullanımın önündeki en büyük engeli oluşturuyor. Google DeepMind ekibi, yapay zeka sistemlerinin güvenli bir şekilde konuşlandırılması için ahlaki performans yerine ahlaki yeterliliğin ölçülmesinin stratejik bir zorunluluk olduğunu vurguluyor.PERFORMANS VE YETERLİLİK ARASINDAKİ KRİTİK FARK Mevcut değerlendirme sistemleri, modelin ‘doğru görünen’ bir yanıt verip vermediğine, yani ahlaki performansına odaklanıyor. Ancak bu durum, modelin altta yatan akıl yürütme sürecini veya durumun ahlaki ağırlığını anlayıp anlamadığına dair bir veri sunmuyor. Araştırmacılar, gerçek bir etik entegrasyon için üç temel zorluğun aşılması gerektiğini belirtiyor:Taklit problemi: Yapay zeka modellerinin mantıksal bir temel olmadan ahlaki muhakemeyi kopyalaması.Karmaşıklık yönetimi: Adalet, dürüstlük ve maliyet gibi çatışan faktörlerin aynı anda dengelenmesi.Kültürel rölativizm: Tek bir kesin doğrunun olmaması; farklı coğrafya ve mesleklerin ahlak kurallarındaki değişkenlik.YAPAY ZEKA AHLAKI İÇİN YENİ YOL HARİTASI Makalede, yapay zekanın etik kapasitesini test etmek amacıyla üç aşamalı bir yöntem öneriliyor. Bu yöntemler, modellerin ezberden mi yoksa muhakemeyle mi yanıt verdiğini ayırt etmeyi amaçlıyor.Beklenmedik senaryolar: Eğitim verilerinde yer almayan, düşük olasılıklı durumlar sunarak modelin mantık yürütüp yürütmediği test edilecek.Değişken analizi: Senaryolardaki yaş veya maliyet gibi küçük detaylar değiştirilerek, yapay zekanın hangi faktöre ahlaki ağırlık verdiği ölçülecek.Bağlamsal adaptasyon: Modellerin evrensel bir doğru sunmak yerine, belirli bir kültürel veya mesleki çerçeveye göre akıl yürütmesini uyarlama yeteneği değerlendirilecek.

Yorumunuz başarıyla alındı, inceleme ardından en kısa sürede yayına alınacaktır.